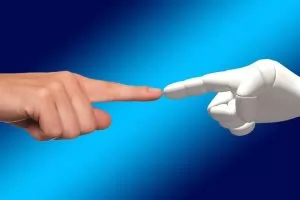

Компанията OpenAI, която разработва популярните изкуствени интелекти ChatGPT и DALL-E, сформира нов екип за безопасност, който ще бъде ръководен лично от основателя и главен изпълнителен директор Сам Алтман. Освен него в новата структура влизат още членовете на борда Адам Д'Анджело и Никол Селигман.

Успоредно с тази новина технологичното дружество анонсира също, че тества нов модел с изкуствен интелект. Все още обаче не е ясно дали това е GPT-5.

Новият екип по сигурността ще дава препоръки относно „критични решения за безопасност и сигурност за проекти и операции на OpenAI“. Първата му задача ще бъде да „оцени и доразвие процесите и предпазните мерки на OpenAI“. След това той ще представи своите констатации пред борда на компанията, в който и тримата ръководители на екипа участват. Бордът от своя страна ще реши как да приложи препоръките на практика.

Сигурността е тема с много история в организацията, а редица ключови изследователи на изкуствен интелект, работили в нея преди, вече споделиха притесненията си в тази посока. Припомняме, че неотдавна съоснователят и главен научен сътрудник на OpenAI Илия Суцкевер напусна фирмата, след като подкрепи опита за "преврат" на борда и временното детрониране на Алтман миналата година.

Той също така беше един от ръководителите на Superalignment екипа, който имаше за цел да „управлява и контролира системи с изкуствен интелект, много по-умни от нас“. Другият ръководител на това звено - Ян Лейк - също обяви своето напускане малко след като Суцкевер си тръгна. В публикация в социалната мрежа X (бившата Twitter), Лейк заяви, че безопасността в OpenAI „е останала на заден план за сметка на лъскавите продукти“. Този критичен, според някои експерти, екип е бил разпуснат.

Миналата седмица пък изследователката на политиките на OpenAI Гретхен Крюгер също обяви своята оставка, позовавайки се на подобни опасения за безопасността. Затова и новото звено се появява в отговор на тези притеснения и има за цел да успокои духовете, убеждавайки всички, че сигурността си остава приоритет на компанията.