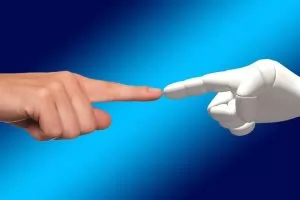

Колумбийски съдия предизвика фурор, като призна, че е използвал изкуствения интелект ChatGPT, за да се произнесе по казуса дали застраховката на дете с аутизъм трябва да покрие всички разходи за медицинското му лечение.

С помощта на чатбота Хуан Мануел Падила, съдия в град Картахена, заключил, че медицинските и транспортните разходи на детето трябва да бъдат платени от застраховката, тъй като родителите му не могат да си ги позволят. Скандалното в казуса е, че съдията се допитал до изкуствения интелект ChatGPT, за да вземе крайното решение. Падила поискал от чатбота да отговори на въпроса: ''Освободено ли е непълнолетно лице с аутизъм от разходите по терапията?'' Отговорът на ChatGPT съответства на окончателното решение на съдията: ''Според разпоредбите в Колумбия непълнолетните, диагностицирани с аутизъм, са освободени от заплащане на такси за терапии''.

Случаят повдигна дискусия относно използването на изкуствения интелект в работата на съдии и адвокати. ChatGPT генерира отговори, като претърсва текстове в интернет, но е доказано, че отговаря различно на един и същи въпрос. Освен това понякога представя невярна информация в името на изобретателни и убедителни отговори.

Падила защити използването на технологията, заявявайки, че може да направи раздутата правна система на Колумбия по-ефективна. Съдията също така е разгледал и предишни решения по подобни казуси, за да състави крайната присъда. Според Падила ChatGPT представя информацията ''по организиран, опростен и структуриран начин'', който може да ''подобри времето за реакция'' в съдебната система.

През 2022 г. Колумбия одобри закон, който позволява на адвокатите да използват новите технологии, за да направят работата си по-ефективна. Самият чатбот обаче се оказва по-притеснен от новата си роля в съдебната система. ''Съдиите не трябва да използват ChatGPT, когато се произнасят по съдебни дела. Това не е заместител на знанията, експертизата и преценката на човешкия ум'', отговаря ботът на въпрос на в. ''Гаридън''. И предупреждава, че ''журналистите също трябва да бъдат внимателни, когато използват цитати, генерирани от ChatGPT в своите статии''.